Iyad Rawhan: “La resistencia social a una tecnología es una de las grandes preguntas que no se hacen”

Hay historias que son poderosas. Tan poderosas que pueden cambiar el curso de los acontecimientos y redefinir el futuro. Y ni siquiera hace falta que provoquen una revolución en el momento en que son contadas, leídas o escuchadas. A veces, una ligera toma de conciencia, un pequeño gesto, son suficientes para producir ese giro de guión en el largo plazo. Efecto mariposa, que lo llaman.

Es el valor que el investigador sirio-australiano Iyad Rawhan atribuye a la ciencia ficción y el reto que puso ayer sobre la mesa a los asistentes en una charla celebrada en Madrid en el marco de la décima edición del ciclo Tech & Society de Fundación Telefónica, con el apoyo de Aspen Institute España.

“¿En qué medida una novela como 1984 nos ha ayudado a reconocer el estado de vigilancia (surveillance state) y nos ha protegido de llegar a él?”, preguntó a la audiencia el director del Max Planck Institute for Human Development de Berlín. “¿En qué medida la conciencia de Un mundo feliz de Aldous Huxley nos lleva a decisiones en el presente para evitar llegar a una sociedad de castas genéticas en la que la estabilidad se mantiene mediante el consumo de drogas?”, se cuestionó.

Igual que hemos sido capaces de llegar (y volver) a la Luna tiempo después de que personas como Verne lo soñaran, ¿Quién nos dice que la ciencia ficción no podría protegernos de los potenciales perjuicios de ciertos avances tecnológicos sin tener que frenar su desarrollo?

Anticiparse al futuro para evitar el desastre

“Estamos acostumbrados a reaccionar al hecho”, comentaba Rawhan. Las redes sociales llevan con nosotros desde 2002, y todavía hoy seguimos teniendo problemas para responder a preguntas esenciales como cuál es su impacto sobre nuestro bienestar emocional o su influencia en la polarización política y social.

Lo mismo ha sucedido y sucede con otras soluciones tecnológicas, como el smartphone y, si no hacemos nada diferente, la inteligencia artificial.

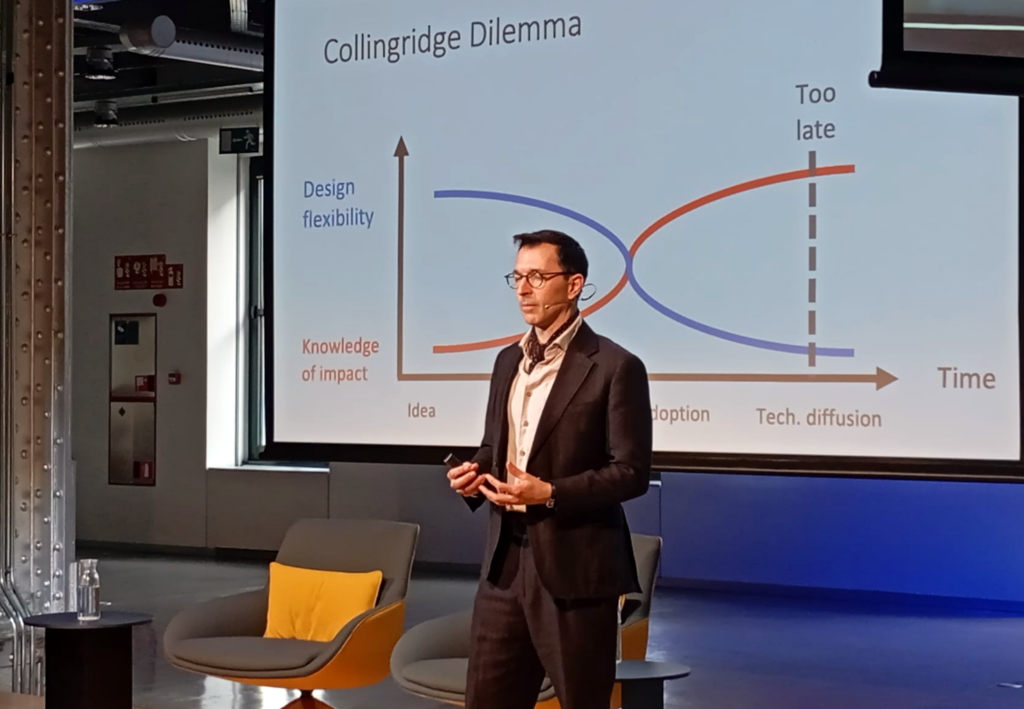

Detengámonos en esta última. Sabemos que la IA tiene un potencial disruptivo como el que tuvo en su momento Internet. Hay quienes la ponen incluso al nivel del fuego o la escritura. Y somos conscientes de que una herramienta de tal potencia traerá consigo riesgos de la misma magnitud. Si intervenimos demasiado pronto, cuando es solo una idea de la que sabemos poco, estaremos “disparando en la oscuridad” —o, como preferimos decir en España, matando moscas a cañonazos—.

Si, por el contrario, esperamos mucho y la tecnología se consolida, tendremos amplio conocimiento sobre la misma pero será muy difícil (y, por tanto, costoso, en el sentido más amplio de la palabra) introducir ningún cambio en ella.

Para el también director del Center for Humans & Machines, la respuesta al Dilema de Collingridge sería conseguir esa comprensión profunda de un determinado avance tecnológico y sus consecuencias en sus fases iniciales, cuando es solo una feliz idea en la mente de algún genio creativo. Y se puede hacer a través de la literatura, pero también de la ciencia: la ciencia de la ciencia ficción (Sci-Fi Science).

El método científico para respaldar a la imaginación

Se atribuye a Frederik Pohl la frase “una buena historia de ciencia ficción debería ser capaz de predecir no el automóvil, sino el atasco”. La pregunta que se hace Iyad Rawhan es si se puede ir un paso más allá del simple relato. De ahí surge el concepto de Sci-Fi Science.

“La ciencia de la ciencia ficción combina la imaginación del futuro con las ciencias del comportamiento”, explica. A través de imágenes y vídeos, o del uso de la realidad virtual o robots, Iyad y su equipo crean simulaciones de escenarios en los que una tecnología en desarrollo ya ha sido desplegada, sumergen a las personas en ellos y observan sus comportamientos y respuestas en ese contexto. Buscan abrir conversaciones que no suelen tener lugar cuando una nueva solución ve la luz.

Cuando una compañía diseña un nuevo producto, como un asistente de voz o un weareable, realiza todo tipo de pruebas de usabilidad. En cierto modo, la organización simula un futuro en el que ese sistema ha sido adoptado para entender qué funciona y qué no para sus potenciales usuarios. Para Rawhan, este sería un tipo de Sci-Fi Science.

Su limitación suele estar en su motivación. El objetivo de estas empresas es vender un producto y ganar cuota en el mercado, por lo que hay preguntas que nunca se realizan. En la mayoría de los casos, las que quedan sin responder son las cuestiones que tienen que ver con la resistencia social a esa tecnología, o con si el usuario está preparado para un avance así.

Ética e impacto social desde el diseño

“No dejaría la innovación exclusivamente en manos de tecnólogos”, asegura. Un ingeniero puede diseñar una herramienta que sea genial si se utiliza de forma ‘perfecta’, pero no tiene garantías de que el usuario final vaya a tener el conocimiento o el contexto para hacer ese uso ideal.

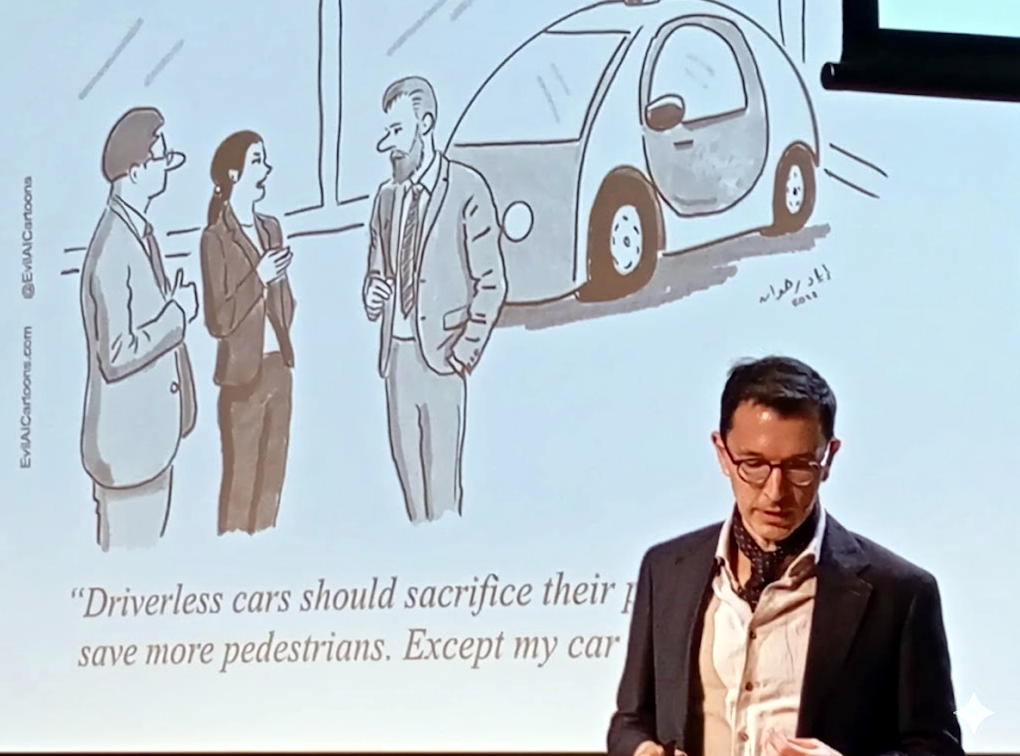

Del mismo modo, no puedes anticipar diferencias culturales como las que puso en evidencia su primer experimento sobre coches autónomos, hace ahora 10 años, cuando aún trabajaba en el MIT Media Lab.

Replicando el dilema del tranvía, Moral Machine preguntó a millones de personas de más de 200 países a quién debería salvar la máquina ante un accidente inevitable en el que, se elija la opción que se elija, siempre habrá víctimas. Los resultados fueron bastante cambiantes. Mientras que en España priorizamos a las personas más jóvenes y a las mujeres y no se tiene tan en consideración el estatus socioeconómico, en territorios como China se muestra preferencia hacia los mayores y quienes respetan las normas de tráfico.

Tampoco puedes saber cuánto pesan valores como la honestidad, la justicia o la legalidad en un contexto en el que se han desplegado plenamente los agentes IA. En 2024, el equipo de Rawhan demostró no solo que nos da menos reparo mentir en nuestra declaración de impuestos si delegamos esta tarea en una máquina, sino que, dado que esa misma máquina tiene menos escrúpulos en amoldarse a nuestras infames intenciones que un gestor humano, las posibilidades de que se produzcan fraudes de este tipo se incrementarán.

La pregunta incómoda viene después: ¿qué hacemos con estos resultados?

Los límites de la ciencia

El mismo Rawhan reconoce que hay científicos que han cuestionado la validez de sus experimentos: la ciencia no estudia lo que no existe todavía, aseveran.

La industria del coche autónomo también se enfrentó a él: lo acusaron de estar matando a personas por ponerlas en escenarios que despertarían sus miedos a usar un invento que venía a salvar vidas.

En su defensa, Iyad Rawhan tiene claro los límites de su trabajo. “No puedes hacerlo para tecnología que está muy lejos en el tiempo o cuyo impacto se dará en un muy largo plazo. Ni para desarrollos que son demasiado disruptivos, como poner fin al envejecimiento”.

En su opinión Sci-Fi Science debe centrarse en aquellos avances que están casi listos para salir a la luz (el punto en el que estaban hace una década los coches autónomos o en el que están ahora los agentes IA) y que tendrán efectos de moderada magnitud en un futuro próximo.

“Incluso si hacemos el trabajo, la gente en el futuro será diferente a cómo es ahora. Pero quizás con esto podemos influir en cómo se produce esta tecnología”, añade. Se trata de incorporar capas a la conversación acerca del impacto de estas grandes innovaciones tecnológicas para las personas y las sociedad. Tal y como quizás hicieron, sin darse cuenta, figuras como Asimov, Orwell, Huxley o Arthur C. Clark.

Así, Rawhan ha reconocido que -mirando hacia adelante- le interesaría investigar asuntos como el IA government (gobiernos dirigidos o gestionados por máquinas) y los cambios en las relaciones humanas con la irrupción de human companions (aunque este último tema ha reconocido que no tenía muy claro que pueda hacerse puesto que ya se están utilizando).

¿El sueño a 10 años?

“Sería maravilloso ver cómo nuestra capacidad de imaginar el futuro y especular de forma inteligente sobre distintos escenarios llega a ser tan buena que no tenemos que pagar el alto precio de experimentar con nuestros hijos, con nuestras relaciones sociales o con nuestras instituciones políticas, rompiéndolas para aprender a mejorarlas. Quizá podamos ejecutar simulaciones con participantes sintéticos de IA para diseñar instituciones sociales y educativas óptimas, sin perjudicar a nadie ni sacrificar nada. Hacerlo todo en el laboratorio y luego elegir el mejor escenario e implementarlo”.